Zagadka 2-megapikselowych aparatów Curiosity

Łazik Curiosity to najbardziej zaawansowane laboratorium naukowe, jakie ludzkość kiedykolwiek wysłała na Marsa. Tym większe zdziwienie musi budzić informacja, że korzysta on z aparatów wykonujących zdjęcia o rozdzielczości zaledwie 2 megapikseli. Wiele współczesnych smartfonów jest wyposażonych w aparaty o kilkukrotnie większej rozdzielczości. Mike Ravine, menedżer ds. zaawansowanych projektów w Malin Space Science Systems wyjaśnia w wywiadzie dla serwisu dpreview.com, dlaczego łazik używa takich właśnie aparatów.

Wpływ na ich wybór miały m.in. ograniczona prędkość transmisji danych z łazika oraz to, że naukowcy projektujący Curiosity dobrze znają matryce, które zostały wykorzystane w aparatach. Jednak najważniejszą przyczyną był fakt, że specyfikacja Curiosity powstała w 2004 roku. Nie można ot tak po prostu zaproponować jakiegoś projektu, a później w trakcie budowy go zmienić i stworzyć coś innego. Ponadto 2 megapiksele i 8 gigabajtów pamięci flash to nie była taka zła konfiguracja w 2004 roku - stwierdził Ravine.

Eksperci zastanawiając się nad wyborem matrycy dla aparatu najpierw wzięli pod uwagę ilość tworzonych przezeń danych. Co prawda Curiosity korzysta z trzech różnych metod przekazywania danych, ale tylko łączność UHF nadaje się do przesyłania obrazków. Antena UHF łączy się z krążącym wokół Czerwonej Planety Mars Recoinnessance Orbiterem, który przekazuje dane na Ziemię. Umożliwia ona przesłanie do 250 megabitów danych dziennie, a jej pasmo jest współdzielone z wieloma innymi instrumentami wysyłającymi zbierane przez siebie informacje. Dla danych z aparatów nie zostaje zbyt wiele miejsca - mówi Ravine.

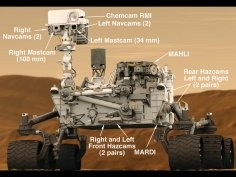

Kolejnym czynnikiem wpływającym na wybór rozdzielczości była konieczność zastosowania takich samych matryc w czterech kamerach (MAHLI, dwóch Mastcam i MARDI). W takim projekcie bardzo ważną rolę odgrywają cena i ryzyko, zarówno to rzeczywiste jak i przewidywane. Co prawda te kamery różnią się wykorzystaną optyką, ale dzięki temu, że wszystkie bazują na tej samej platformie, nie musieliśmy wykonywać testów i uzyskiwać certyfikatów dla wielu platform. To czyni całość tańszym i bardziej niezawodnym rozwiązaniem, niż gdybyśmy mieli różne platformy - wyjaśnia ekspert. Dodaje, że specjalistom szczególnie zależało na tym, by kamera MARDI, która jest skierowana w dół i wykonywała fotografie podczas lądowania Curiosity, pracowała z jak największą prędkością. Układ KAI-2020 był najmniejszym chipem Kodaka zdolnym do wykonywania ujęć wideo HD w rozdzielczości 720p. Zastanawialiśmy się też nad 4-megapikselowym czujnikiem, ale pracował on dwukrotnie wolniej. A matryce CMOS dostępne w 2004 roku nie były wystarczająco dobre. Teraz stanowiłyby interesujące rozwiązanie, ale nie wówczas - stwierdził.

Ponadto, jak wyjaśnił, NASA ma kilkadziesiąt lat doświadczeń z układami Kodaka i wykorzystaną w Curiosity linią Truesense. Eksperci agencji wiedzą jak je oprogramować i jak odpowiednio ustawić ich taktowanie.

Komentarze (7)

reymondo, 10 sierpnia 2012, 07:30

Przy założeniu, iż obraz się nie zmienia, rozdzielczość zdjęcia da się zwiększyć poprzez wykonanie sekwencji poprzesuwanych zdjęć. Nie ma zatem problemu z dokładniejszą rejestracją obrazów. Z filmami natomiast może być gorzej ...

lucky_one, 10 sierpnia 2012, 11:53

Mam wrażenie, że to obecne szaleństwo na punkcie rozdzielczości jest jakieś nieuzasadnione.. nie wiem, może wykreowane przez marketingowców? Kiedyś tego wszystkiego nie było, a ludzie potrafili robić dobre zdjęcia, dobre filmy..

A teraz mamy po 10 Mpx, rozdzielczość hd i inne wynalazki.. i po co? Po to żeby robić sweet-focie i nagrywać telefonami głupkowate filmiki, a później zaśmiecać tym internet?

Wg mnie najważniejsze nie jest jak się pokazuje (na zdjęciu, w filmie, grze, muzyce, teledysku), ale co się pokazuje..

Niestety z moich obserwacji wynika że iloczyn tych dwóch czynników jest stały. 'Jak' od kilkunastu lat bije kolejne rekordy dokładności, zaś 'co' staje się coraz bardziej pomijalne

Dyskutant, 10 sierpnia 2012, 14:22

Może chodzi o to, że w niektórych aparatach, jeśli nie w prawie każdym, zdjęcie robione przy najwyższej możliwej rozdzielczości jest niezbyt dobrej jakości, a robione przy mniejszych rozdzielczościach, gdzie jeden piksel matrycy nie odpowiada jednemu pikselowi na zdjęciu, czyli przy uśrednianiu, jakość znacznie się poprawia

MrVocabulary (WhizzKid), 10 sierpnia 2012, 22:58

Częściowo wykreowane przez marketingowców, częściowo wynikające stąd, że aparat analogowy to dobrej jakości matrycy ma spokojnie 15-20 milionów pikseli. A mnie dziwi, dlaczego nie zostawią luki w specyfikacji na OSIEM LAT DO PRZODU...

mikroos, 11 sierpnia 2012, 09:04

Jak chcesz zostawić lukę, skoro musisz napisać oprogramowanie i zaprojektować cały pozostały sprzęt (anteny, nośniki danych itd.) ?

Równie dobrze mógłbyś projektować budynek z nadzieją, że za osiem lat powstanie dostatecznie wytrzymały beton, byś mógł ten budynek postawić...

Przemek Kobel, 11 sierpnia 2012, 19:52

Ja bym tu zaprotestował. Nawet gigapiksele nie spowodują, że fotka będzie dobrze zrobiona. Najpierw pan operator musi wiedzieć czego chce, a jeśli nie wie, to musi to czuć. I zapewniam, że większość "słit foci" to nie zasługa megapikseli czy nawet panów operatorów, tylko jakichś fotoszopiarzy. Niestety.

reymondo, 13 sierpnia 2012, 07:31

hola hola ... chyba wszyscy odbiegają od tematu. Nie chodzi tutaj o sweet fotki na facebooka'a ale o zdjęcia rejestrujące. Szczegółowość tych zdjęć jest bardzo ważna. Walory artystyczne są w tym przypadku bardzo mało istotne ...