Sztuczna inteligencja rozwiązuje zagadkę Wielkiego Zwoju Izajasza

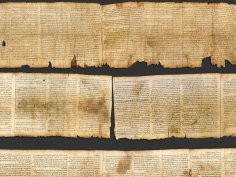

Sztuczna inteligencja pomogła w rozwiązaniu jednej z zagadek zwojów znad Morza Martwego. Przeprowadzona przez algorytm analiza potwierdziła, że jeden z najstarszych zwojów z Qumran – Wielki Zwój Izajasza, pochodzący z ok. 125 roku p.n.e. – został spisany przez dwie osoby, a nie przez jedną.

Wielki Zwój Izajasza to kopia Księgi Izajasza. Zanim odkryto zwoje z Qumran historię tekstów biblijnych mogliśmy studiować praktycznie wyłącznie ze średniowiecznych manuskryptów z około 1000 roku. Zwoje znad Morza Martwego są jak kapsuła czasu. Pozwalają nam podróżować do czasów, w których Biblia dopiero powstawała. Dają nam więc wyjątkowy wgląd w kulturę i środowisko, które ją wytworzyło, mówi Mladen Popovic z Uniwersytetu w Groningen.

Wielki Zwój Izajasza jest naprawdę wielki. Ma 734 centymetry długości. To największy, jeden z najlepiej zachowanych i jedyny niemal kompletny zwój z Qumran. Dotychczas naukowcy nie byli pewni, czy spisała go jedna czy dwie osoby, gdyż charakter pisma na całym zwoju jest niezwykle podobny.

Popovic i jego zespół zaprzęgli sztuczną inteligencję do analizy zdjęć zwoju. Zadaniem algorytmu było przyjrzenie się literom, przeanalizowanie trudnych do wychwycenia dla człowieka zmian w kroju i stylu liter oraz stwierdzenie, czy Wielki Zwój wyszedł spod jednej ręki, czy też pracowało nad nim więcej osób o podobnym charakterze pisma.

Sztuczną inteligencję zaprzęgnęliśmy do pracy dlatego, że mamy tutaj podobny charakter pisma. Chcieliśmy dowiedzieć się, czy pisały dwie osoby czy jedna, która w pewnym momencie zmieniła narzędzie do pisania, wyjaśnia Charlotte Hempel z University of Birmingham. Teraz możemy zadać sobie jeszcze jedno fascynujące pytanie. Czy tak duże podobieństwo w charakterze pisma dwóch osób wynikało z faktu, iż mamy tutaj do czynienia z wysokiej klasy profesjonalistą zdolnym do naśladowania charakteru pisma innej osoby i czy obaj skrybowie pochodzili z tego samego kręgu, w którym uczyli się swojej profesji, dodaje Hempel.

Komentarze (14)

thikim, 22 kwietnia 2021, 10:18

Nie sztuczna inteligencja bo takowe nie istnieją tylko algorytm komputerowy.

Gdyby powstała sztuczna inteligencja to kwestią czasu byłaby technologiczna osobliwość.

Gdzieś kiedyś jakieś sympozjum dotyczyło jednego z tych marketingowych słówek (zapomniałem którego): coś jak sztuczna inteligencja, innowacyjność i takie tam bla bla wymyślane przez teoretyków lub marketingowców.

Pierwszy prelegent zmieszał z błotem ten termin.

Wszyscy następni robili wszystko co mogli żeby zastąpić ten termin zbrukany z błotem jakimś zamiennikiem. Była zabawa, bo prawie każdy w co drugim zdaniu go pierwotnie użył

"Musimy innowacyjnie rozwijać innowacyjność naszej gospodarki. Będziemy tu siedzieli i pier**lili (za co nam płacą) chociaż nikt nigdy nie skorzysta w prawdziwej firmie z naszej wiedzy".

cyjanobakteria, 22 kwietnia 2021, 10:29

To się nazywa narrow AI po angielsku.

https://www.springboard.com/blog/narrow-vs-general-ai/

Jajcenty, 22 kwietnia 2021, 17:31

To trochę nadużycie pojęcia algorytm. Cały algorytm to: tanh(sum(wi*xi)). W skrócie, ten sam 'algorytm' odróżnia jabłko od truskawki od pryszcza od raka. Zwykle różne algorytmy rozwiązują różne zadania.AI rozwiązuje różne zadania jednym (mniej więjcej) algorytmem. Ale zgadzam się, ciągle jeszcze z AI nie pogadasz o życiu i śmierci, a rano nie zrobi jajecznicy.

cyjanobakteria, 23 kwietnia 2021, 12:49

Kiedyś znajoma w pracy zrobiła krótki wykład o AI (2h). Sam nie jestem ekspertem w tej dziedzinie, to były podstawy podstaw, ale byłem pod wrażeniem ile można zdziałać stosunkowo prostą matematyką w klasyfikacji obiektów.

Rowerowiec, 23 kwietnia 2021, 22:24

Jeszcze kilka lat temu nazywano te algorytmem maszynowym lub uczeniem maszynowym. Teraz wszędzie już sztuczną inteligencją się zwie, ponieważ to jest bardziej medialne określenie. Ludzie którzy nie siedzą w temacie pomyślą że takie coś już jest. Niestety. Ale cieszmy się że w końcu mamy coraz więcej zastosowań komputera.

cyjanobakteria, 23 kwietnia 2021, 23:45

Nie dostrzegałbym przesadnego spisku marketingowców. Wyjdź na ulicę, wytypuj ofiary i zapytaj co to "uczenie maszynowe" oraz co to "sztuczna inteligencja"

darekp, 24 kwietnia 2021, 07:28

"Sztuczna inteligencja" chyba jednak bardziej powszechnie występuje w ludzkiej świadomości, niż "uczenie maszynowe", choćby nawet w dowcipach o blondynkach ;) A ile filmów hollywoodzkich o AI nakręcono w ciągu kilku-kilkunastu ostatnich lat w porównaniu z filmami o "uczeniu maszynowym"....

cyjanobakteria, 24 kwietnia 2021, 10:21

Nawet statystyczny deweloper w IT niedawno się dowiedział co to ML i DL. Sam nie kojarzyłem tych określeń przed 2014, o ile mnie pamięć nie myli. Wtedy rozpocząłem pracę w firmie, gdzie była zatrudniona osoba od ML w sąsiednim teamie. W ciągu ostatnich 5 lat kilka osób się w tej samej firmie zainteresowało tematem. Zgadzam się, że jest tak napisane aby było bardziej zrozumiałe, a nie żeby tworzyć złudzenia. Nie wiem czy to wynika z mojej poprzedniej wypowiedzi.

Jajcenty, 24 kwietnia 2021, 10:43

Bo moc i pamięć. Osiągnęliśmy wystarczający poziom i dziedzina zaczęła się rozwijać lawinowo. Maleństwa typu Raspberry Pi mogą liczyć w czasie rzeczywistym.

peceed, 25 kwietnia 2021, 13:56

Jest nawet dowód na to, że sztuczna inteligencja nigdy nie powstanie. Bo dotychczas każdy rozwiązany problem z domeny AI stawał się "kolejnym zwykłym softem na komputer", jak dla przykładu szachy czy obecnie zagadnienia klasyfikacyjne. Gdy coś rozwiążemy kolejne, znowu staną się one "zwykłymi algorytmami".

Nic dziwnego, deep learning to była nowość. Teoretycznie badano bardzo głębokie sieci od dawna, ale dopiero niedawno udało się uzyskać "nadludzkie" rezultaty w bardzo szerokiej klasie problemów, głównie dzięki większej mocy obliczeniowej.

Sam nad tym przez krótką chwilę pracowałem, ale raczej od strony znalezienia zupełnie nowych algorytmów które pozwalałyby efektywnie uczyć bardzo głębokie sieci, i w czasie kiedy jeszcze nie było to modne.

Niestety wyszedłem z błędnego założenia, że mózg nie korzysta ze wstecznej propagacji błędów, dlatego żaden pomysł nie miał szansy zadziałać, choć pewne powinny mieć sens w znacznie większych skalach (np. mózg musi wykorzystywać permanentną konkurencję pomiędzy obwodami, i powinny istnieć mechanizmy przypominające wolny rynek)

Wciąż może być to jedna osoba z osobowścią wieloraką

Antylogik, 25 kwietnia 2021, 16:38

Jak nie istnieje, jak istnieje? Gdyby to się nazywało "komputerowa inteligencja", to można byłoby się zgodzić z tym zdaniem. Ale nie, gdy mowa o sztucznej. Bo co to znaczy sztuczna? Intuicyjnie rozumiemy to jako nienaturalną. Ale też możemy rozumieć to słowo nieco szerzej, a mianowicie wychodząc od słowa "sztuczka", czyli iluzji, możemy przyjąć, że jest to synonim słowa nieprawdziwa, złudna, iluzoryczna inteligencja. Mamy sztuczny miód, a wy powiecie, że sztuczny miód to nie miód, tylko wygląda jak miód. I właśnie dlatego, że wygląda i trudno go odróżnić od miodu, nazywa się go miodem.

I to właśnie stanowi jakby esencję sztucznej inteligencji. Efekt jest taki sam. Przecież CELEM inteligencji jest wygranie w szachy, a nie SAMO granie. To właśnie SZTUCZKA. I dlatego AI to JEST inteligencja. Na jakiej podstawie w ogóle twierdzisz, że inteligencja to nie jest jakiś algorytm?

Operujecie tzw. heurystykami, prowadzącymi często do błędnego rozumowania (dla programistów - douczyć się o słowie heurystyka, bo nie chodzi o definicję informatyczną). Macie słowo inteligencja i od razu wam się wydaje się, że to musi być zjawisko świadome, a nie zwykły algorytm.

Przypomina mi się ostatnio usłyszany dowcip. Przychodzi Polak do sklepu w Anglii, ale nie umie mówić po angielsku i próbuje wytłumaczyć sprzedawcy co chce kupić. I Polak do niego mówi: Chcę kupić ... i pokazuje mu rękami kształt kuli. Sprzedawca myśli i myśli i nagle wpada: You want to buy a ball? Polak zadowolony krzyczy: yes! Sprzedawca już chce ruszyć po jakąś piłkę, a wtedy Polak do niego: Czekaj. Teraz się skup. Zaczyna mu pokazywać rękami jakby chciał coś przeciąć piłą. I dodaje: Chodzi o piłkę mechaniczną....

Jajcenty, 25 kwietnia 2021, 19:52

do metalu.

venator, 26 kwietnia 2021, 03:34

Artykuł podsumowujący obecny etap funckjonowania AI vel modeli uczenia maszynowego:

https://mlodytechnik.pl/technika/30612-czego-ai-nie-moze-i-co-ja-blokuje

Jednak naukowcy Google’a wsadzili kij w mrowisko, udowadniając, że nawet najlepsze w swojej klasie metodologie testowania nie dają pewności co do wymaganej wydajności w świecie rzeczywistym. Po testach niektóre modele będą znakomite w świecie rzeczywistym, ale niektóre rozczarują, i nie można tego przewidzieć z wyprzedzeniem.[...]

Społeczność badaczy uczenia maszynowego głęboko poruszył opublikowany w listopadzie 2020 r. artykuł zespołu AI Google pt. "Underspecification Presents Challenges for Credibility in Modern Machine Learning". Dokument zwraca uwagę na szczególnie drażliwy problem polegający na tym, że nawet jeśli modele uczenia maszynowego przechodzą testy dobrze, nie radzą sobie równie dobrze w świecie rzeczywistym. Błędy modeli, które nie osiągają wydajności w testach w świecie rzeczywistym, są znane od dawna, ale ta praca jest pierwszą, która publicznie udowadnia i wymienia ową "underspecification" (co można tłumaczyć jako "niedookreślenie") w roli głównej przyczyny problemów.

Parę lat temu wydawało się, że rewolucja jest tuż za rogiem, co byłoby dla naszego kraju, trapionego głęboką niewydolnością systemu zdrowia, iskierką nadziei. Jednak:

Najbardziej chyba bolesną porażką AI, której nie omawia się i nie opisuje tak szeroko w mediach, jak jeszcze kilka lat temu szumnych zapowiedzi, jest to, co stało się ze sławnym Watsonem firmy IBM, który miał wspierać m.in. diagnostykę raka. Okazało się, że co innego wygrać z ludźmi teleturniej, a co innego dać sobie radę w roli lekarza. Jak pamiętamy, a pisał o tym także przed laty MT, system ten miał nawet "pozbawić lekarzy pracy".

Więcej:

https://mlodytechnik.pl/technika/30614-watson-nie-wygryzl-lekarza-i-bardzo-dobrze

Okazało się jednak, że Watson nie potrafi samodzielnie uzyskać wglądu do literatury medycznej ani też nie może wydobywać informacji z elektronicznej dokumentacji zdrowotnej pacjentów. Jednak najcięższy zarzut wobec niego opierał się na konstatacji, że nie umie sprawnie porównać nowego pacjenta z innymi starszymi przypadkami chorych na raka i odkryć symptomów, które są na pierwszy rzut oka niewidoczne.

Jednak nie wszystko stracone ponieważ:

są dziedziny, w których okazał się niezwykle przydatny. Produkt Watson for Genomics, który został opracowany we współpracy z Uniwersytetem Karoliny Północnej, Uniwersytetem Yale i innymi instytucjami, jest wykorzystywany przez laboratoria genetyczne do generowania raportów dla onkologów. Watson pobiera plik z listą mutacji genetycznych u pacjenta i w ciągu kilku minut potrafi wygenerować raport, który zawiera sugestie dotyczące wszystkich ważnych leków i badań klinicznych. Watson stosunkowo łatwo radzi sobie z informacjami genetycznymi, ponieważ są prezentowane w ustrukturyzowanych plikach i nie zawierają dwuznaczności - albo mutacja jest, albo jej nie ma.

Ale największa rewolucja to chyba modelowanie białek. Tu jest pole do popisu co zresztą ma swój praktyczny wymiar w walce z sars-cov-2.

Z obu artykułów wynika, że "sztuczna inteligencja" najbardziej obecnie sprawdza się wycinkowo, co bardziej pasuje do definicji algorytmu. Aczkolwiek taki GPT-3 firmy OpenAi wygląda obiecująco: Tu warto wtrącić, iż akurat GPT-3 może być wyjątkiem, czyli pierwszym przykładem sztucznej inteligencji, która, choć nie jest "ogólna", przekroczyła definicję "wąskiej". Algorytm, choć był szkolony do pisania tekstów, ostatecznie potrafi także tłumaczyć między językami, pisać kod, autouzupełniać obrazy, wykonywać zadania matematyczne i inne zadania związane z językiem

Z artykułu wynika, że GPT-3 jest "mniejszy" tysiąc razy niż ludzki mózg, to jest kwestią czasu gdy te parametry się zrównają.

Jajcenty, 26 kwietnia 2021, 09:53

Tak, jeszcze nie wymyśliłem jak to obejść. Dobry model to 95% poprawnych rozpoznań, oczywiście jest w stanie ocenić gazylion zdjęć. z fałszywymi rozpoznaniami nie ma dużego problemu - te kilka sztuk wyłapie człowiek. Ale co 5% przypadków nierozpoznanych? Wychodzi na to, że i tak człowiek musi zobaczyć wszystkie obrazki. Zatem musi zostać jak jest, robotę robi człowiek, a robota można jedynie użyć do sprawdzenia po człowieku.